RAG vs ChatGPT dans la commande publique

L'irruption de l'Intelligence Artificielle Générative a démocratisé l'accès à des outils puissants de rédaction. Aujourd'hui, tout technicien peut demander à un chat généraliste de rédiger un e-mail ou de résumer un texte. Cependant, lorsque nous transférons cette technologie au secteur de la commande publique, nous constatons que le manque de rigueur de ce type de modèles d'IA peut compromettre le processus d'appel d'offres.

Dans un environnement régi par la Loi sur les Contrats du Secteur Public (LCSP) et sujet à fiscalisation, une donnée inventée n'est pas une anecdote ; c'est un risque légal grave.

C'est pourquoi les responsables de la technologie (CTO) et de la sécurité (CISO) du secteur GovTech misent sur des architectures avancées comme RAG (Retrieval-Augmented Generation) face à l'utilisation de modèles génériques. Mais qu'est-ce que c'est exactement et pourquoi est-ce fondamental pour travailler avec des appels d'offres ?

Le risque structurel : pourquoi l'IA généraliste invente des données

Les Grands Modèles de Langage (LLM) généralistes, comme les versions standard de ChatGPT ou Gemini, ne sont pas des bases de données de connaissances vérifiées ; ce sont des moteurs probabilistes de prédiction de texte. Ils ont été entraînés avec d'immenses quantités d'informations d'internet, mais ne "savent" pas ce qui est vrai et ce qui est faux ; ils calculent uniquement quel mot est statistiquement le plus probable pour suivre le précédent afin de former une phrase cohérente.

Le problème critique dans le secteur juridique est que ces modèles sont conçus sous un impératif de "répondre toujours". Leur fonction objectif est de satisfaire la requête de l'utilisateur en maintenant la fluidité de la conversation, non de garantir l'exactitude factuelle.

Cela signifie que, face à une lacune d'information spécifique (par exemple, le contenu exact d'un article de la LCSP ou un dossier concret qui n'était pas dans son entraînement), le modèle ne s'arrête pas. Au lieu d'admettre son ignorance, son algorithme "remplit" ce vide en générant une information qui semble véridique et respecte la structure du langage juridique, mais qui est fictive. On appelle ce phénomène "hallucination" : l'IA invente des données, des dates, des articles ou de la jurisprudence avec une totale assurance et cohérence grammaticale, créant un piège de confiance parfait pour le technicien qui l'utilise.

Qu'est-ce que RAG et comment cela résout-il le problème ?

RAG (Génération Augmentée par Récupération) est une architecture qui empêche l'IA de répondre "de mémoire". Elle agit comme un modèle d'IA "expert", à condition de disposer des bonnes sources d'information.

Le flux technique étape par étape :

- Retrieval (Recherche) : Quand vous posez une question, le système ne va pas au modèle de langage. Il cherche d'abord dans une base de données vectorielle sécurisée où sont indexés la LCSP en vigueur, les cahiers des charges du dossier et la jurisprudence réelle.

- Filtrage : Le système sélectionne uniquement les paragraphes qui contiennent la réponse véridique (ex. le texte exact de l'Art. 204 LCSP).

- Generation (Génération) : Maintenant oui, il envoie ces paragraphes au modèle d'IA avec une instruction stricte : "Réponds à l'utilisateur en utilisant UNIQUEMENT cette information. Si elle n'est pas ici, dis que tu ne sais pas".

Tableau comparatif : ChatGPT vs. Architecture RAG (Tendios)

| Caractéristique | IA Générique (ChatGPT, etc.) | Architecture RAG (Tendios) |

|---|---|---|

| Source de connaissance | Mémoire d'entraînement (internet passé) | Base de données documentaire mise à jour |

| Réponse face au doute | Invente quelque chose de plausible ("Hallucination") | "Il n'y a pas d'information suffisante dans les documents" |

| Traçabilité | Boîte noire (sans sources) | Citations directes au BOE/Cahier des charges avec lien |

| Mise à jour | Coupures de connaissances anciennes | Temps réel (connecte avec des sources vives) |

Avez-vous besoin de faire une consultation sur la commande publique ?

Cas d'utilisation réel : Validation de durabilité

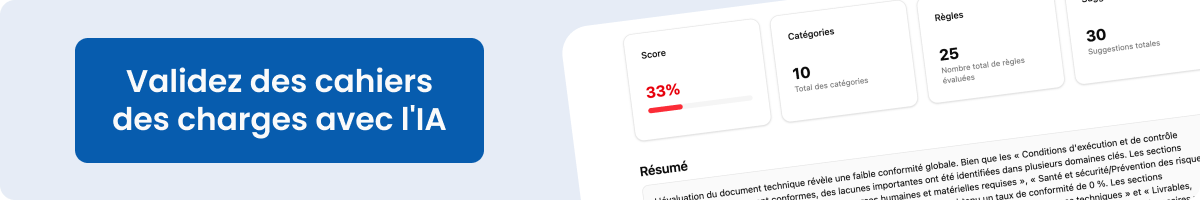

Pour comprendre l'impact, voyons un jour dans la vie d'un technicien de passation de marchés qui doit valider si un cahier des charges respecte les critères écologiques.

- Processus manuel (Sans RAG) : Télécharger le PDF (150 pages), chercher "durabilité" avec Ctrl+F, ouvrir le BOE pour comparer avec la LCSP, consulter le guide de l'achat écologique... Temps estimé : 3 heures.

- Processus avec Tendios (RAG) : Vous téléchargez le cahier des charges. Vous demandez : "Respecte-t-il les exigences de l'Art. 201 LCSP ?". Le système scanne le document, croise avec l'article en vigueur de la loi et génère un rapport de conformité avec des citations. Temps estimé : 20 minutes.

Quand utiliser chaque outil

Il ne s'agit pas de diaboliser les modèles génériques, mais de les utiliser pour ce à quoi ils servent.

- Quand vous POUVEZ utiliser un LLM comme ChatGPT :

- Brainstorming initial d'idées créatives.

- Rédiger des e-mails internes non confidentiels.

- Résumer des nouvelles générales du secteur.

- Quand vous DEVEZ utiliser une IA Spécialisée (RAG) :

- Rédiger des Cahiers des Charges (PCAP/PPT) avec sécurité juridique.

- Réaliser des consultations légales.

- Valider la conformité normative d'un dossier.

Êtes-vous une entité du secteur public ?

Êtes-vous une entreprise privée ?

Les limites du RAG

Même la technologie RAG a des limites. La qualité de la réponse dépend de la qualité de la source (si la base de données n'est pas mise à jour avec le dernier BOE, la réponse sera obsolète) et ne remplace pas le critère juridique final du technicien. Chez Tendios, nous atténuons cela avec une mise à jour automatique quotidienne à partir de sources officielles, mais la supervision humaine reste clé.

Conclusion : Technologie pour décisions critiques

Dans le secteur public, les décisions doivent être justifiées. La technologie RAG n'est pas seulement une amélioration technique ; c'est la différence entre utiliser un assistant créatif et utiliser un outil d'audit professionnel.

En priorisant la vérifiabilité et la discipline documentaire, nous convertissons l'Intelligence Artificielle en un allié fiable pour la gestion de dossiers complexes, éliminant la peur de la "donnée inventée".

Voulez-vous essayer l'IA spécialisée dans la commande publique ?